導入:そのAIコード、本番環境に適用する勇気はありますか?

「AIが書いたTerraformコードを、そのまま本番環境にapplyするなんて正気の沙汰じゃない」

インフラ構築の現場において、このような声が上がることは珍しくありません。インフラエンジニアにとって、たった一行の設定ミスがサービス全停止につながる恐怖は、常に隣り合わせのものだからです。

しかし、マルチクラウド化が進み、マイクロサービスごとにインフラが細分化された現在、手動でのコード記述(あるいは既存コードのコピー&ペースト)は限界を迎えています。「記述コストの削減」は待ったなしの課題ですが、AI特有の「ハルシネーション(もっともらしい嘘)」が壁となり、多くの現場で導入が足踏みしています。

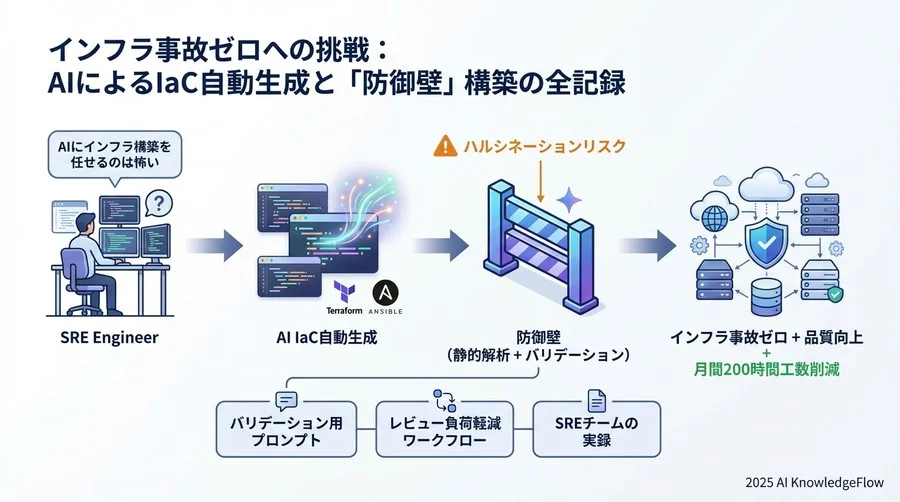

本記事では、AIに対する懸念を抱える開発現場が、いかにしてAIを「信頼できるパートナー」へと変貌させ、インフラ事故ゼロのまま大幅な工数削減を達成できるか、その実践的なアプローチを解説します。成功の鍵は、AIの出力を鵜呑みにせず、徹底的な「防御壁」を構築することにあります。

1. プロジェクト背景:記述コストの増大と「コピペミス」の限界

マルチクラウド化に伴うIaCコード量の爆発

現代のインフラ開発現場では、AWSをメインにしつつ、分析基盤にはGoogle Cloud、一部の連携にはAzureを使用するといったマルチクラウド構成が一般的になりつつあります。それに伴い、Terraformのモジュール数は数百に及び、AnsibleのPlaybookも複雑に絡み合うケースが珍しくありません。

さらに近年はインフラの高度化が加速しています。例えばAWS公式ブログ(2026年2月時点)によると、他クラウドとのプライベート高速ネットワーク接続を実現する「AWS Interconnect – multicloud(プレビュー)」や、EC2上でLambda関数を実行する「AWS Lambda Managed Instances」、複数ステップのAIワークフローに対応する「AWS Lambda Durable Functions」などの新機能が続々と登場しています。これによりアーキテクチャの選択肢が広がる一方で、新規サービスを立ち上げるたびに数千行規模の構成ファイルが必要となる課題が生じています。これをゼロから書くことは現実的ではなく、多くの現場では「似たような構成の過去プロジェクト」からコードをコピーし、パラメータを書き換えるという作業が行われています。

ボイラープレート記述によるエンジニアの疲弊

しかし、この「コピペ運用」こそが多くの組織で技術的負債を生む要因となっています。不要な設定まで引き継いでしまったり、変更すべき変数を修正し忘れたりといったミスは後を絶ちません。エンジニアチームは、本来注力すべきアーキテクチャ設計やパフォーマンスチューニングではなく、巨大なYAMLやHCL(HashiCorp Configuration Language)の記述と、その些細なミス探しに忙殺されてしまうのです。

「エンジニアがYAML職人になっている」——そんな状況に陥っている現場では、月間のインフラ構築工数が限界を超えることも少なくありません。AIによる自動化は、単なる効率化の手段というよりも、運用コストの爆発とプロジェクトの破綻を防ぐための緊急課題と言えます。

チーム内で挙がった「AI導入への慎重論」

一方で、AI導入に対して現場のベテランエンジニアから慎重論が挙がることも珍しくありません。「生成AIにコードを書かせたら、存在しないリソースタイプをでっち上げた」「セキュリティグループの設定が甘かった」といった経験談は、多くのエンジニアが共有する懸念事項です。

AIモデルの進化は著しく、複数の公式情報によれば、2026年2月にGPT-4oなどのレガシーモデルが廃止され、長い文脈理解やツール実行能力、汎用知能が大幅に向上したGPT-5.2(InstantおよびThinking)へと主力モデルが移行しています。これにより、コード生成の構造化や明確さが劇的に改善されました。しかし、推論能力やコーディング性能がどれほど向上しても、AIが生成するコードには「ハルシネーション(もっともらしい嘘)」のリスクが依然として含まれます。特にインフラ設定においては、一つのミスが重大なセキュリティ事故に直結するため、AI導入は「リスク増大」と同義だと捉えられがちです。また、レガシーモデルで構築した自動化スクリプトやAPI連携の仕組みを、最新モデルへ移行・検証する際の手間も現場の負担となります。

こうした課題に直面した際、重要になるのが「AIに完成品を作らせない」という合意形成です。AIにはあくまで「ドラフト(下書き)」を作らせ、人間と静的解析ツールがそれを厳格に検閲するプロセスを構築するのです。目標を「完全自動化」ではなく、「記述コストの削減と品質担保の両立」に設定することが、導入成功の鍵となります。

2. 検証フェーズ:AI生成コードの「嘘」を見抜くための品質基準策定

ChatGPT/Claudeによる構成ファイル生成精度の比較検証

AI導入のPoC(概念実証)フェーズにおいて、主要なLLM(大規模言語モデル)を活用したTerraformやAnsibleのコード生成能力の検証は重要なステップです。具体的には、「AWS上にVPC、パブリックサブネット、EC2インスタンス、およびRDSを構築するTerraformコード」といった要件を指示として与え、その出力を評価するアプローチが一般的です。

検証の傾向として、ChatGPTやClaudeといった主要なAIであれば、単純な構文エラー(Syntax Error)が発生することは稀です。しかし、論理的なミスや、セキュリティのベストプラクティスに反する記述(Security Groupの全開放など)が散見されるケースは珍しくありません。AIはあくまで確率的に確からしいコードを出力しているに過ぎないため、生成された構成ファイルが自社のインフラ要件や最新のクラウドリファレンスに適合しているか、厳密な比較検証が求められます。

実際に発生したハルシネーションの事例

IaC(Infrastructure as Code)の自動生成において、AIのハルシネーション(もっともらしい嘘)が引き起こすリスクは重大です。よくある「ヒヤリハット」事例として、以下のようなケースが報告されています。

たとえば、AIに「社内アクセス限定のS3バケット」の設定を生成させたとします。AIは一見すると完璧なコードを出力しますが、そこには実在しない暗号化オプションのパラメータが含まれていることがあります。Terraformのplanコマンドを実行して初めてエラーとして検知されますが、もしこれが構文的に正しいものの意図しない公開設定を引き起こす内容だった場合、深刻なセキュリティ事故につながりかねません。

また、AnsibleのPlaybook生成において、モジュールのパラメータ名を微妙に間違えたり、非推奨の書き方をしたりするケースもあります。AIは過去の膨大な学習データに依存しているため、最新のクラウド環境の変更に追いついていないことが主な原因です。例えば、AWS環境においてMSK(Amazon Managed Streaming for Apache Kafka)のトピック管理APIが新しくなり、CloudFormationテンプレートの更新が推奨されるような最新のアップデート(2026年時点)があっても、AIは古い仕様や非推奨の構文を「正解」として出力してしまう傾向があります。

「AI + 静的解析ツール」による二重チェック体制

これらのリスクを考慮すると、「AIの出力は常に疑う」という原則を大前提とする必要があります。そして、人間の目でレビューする前に、機械的なフィルターを通す「防御壁」の仕組みを導入することが推奨されます。

具体的には、以下のようなツール群を組み合わせた自動検証パイプラインの構築が効果的です。

- Terraform:

terraform validate(構文チェック)、tflint(Lintツール)、tfsecまたはCheckov(セキュリティスキャン) - Ansible:

ansible-lint - クラウドリソース全般: AWS Security HubのCSPM(Cloud Security Posture Management)の最新コントロールを用いたコンプライアンスチェック

AIが生成したコードを、まずこれらの静的解析ツールやセキュリティスキャンにかけます。エラーや警告が検出された場合、そのエラーメッセージをそのままAIにフィードバックして修正させるアプローチが有効です。この「自己修正ループ」をシステム的に回すことで、人間が目にする段階でのコード品質を劇的に向上させ、インフラ事故のリスクを最小限に抑えることが可能です。

3. 実装プロセス:安全装置を組み込んだプロンプトエンジニアリング

コンテキスト不足を防ぐ「前提条件注入プロンプト」の設計

AIが誤ったコードを生成する最大の原因は「コンテキスト(文脈)不足」です。単に「EC2を作って」と言うだけでは、命名規則も、タグ付けのルールも、セキュリティ要件も伝わりません。

実務の現場では、組織固有のルールをまとめた「システムプロンプト(前提条件)」をテンプレート化する手法が有効です。以下はその一例です。

あなたは熟練したSREです。

以下の制約条件(Constraints)を厳守してTerraformコードを生成してください。

## Constraints

1. Provider Version: AWS Provider v5.0以上を使用すること。

2. Naming Convention: リソース名は `project-env-service-resource` の形式(例: `prj-dev-web-ec2`)とすること。

3. Tagging: 全リソースに `Environment`, `Owner`, `CostCenter` タグを付与すること。

4. Security: Security GroupのIngressは必要最小限にし、`0.0.0.0/0` の許可は明示的な指示がない限り禁止とする。

5. Output: コードだけでなく、主要な変数の説明をコメントとして記述すること。

このように、バージョンや命名規則、セキュリティポリシーを明文化して毎回入力(あるいはAPI経由で注入)することで、AIの出力は驚くほど均質化されます。

Ansible Playbookの冪等性を担保する制約指示

Ansibleにおいては、「冪等性(何度実行しても同じ結果になる性質)」の担保が重要です。AIは時折、shellやcommandモジュールを安易に使ってしまい、冪等性を壊すコードを書くことがあります。

これを防ぐため、プロンプトには以下のような指示を追加することが推奨されます。

- 「可能な限り専用モジュール(

file,service,userなど)を使用し、shellモジュールの使用は避けること」 - 「

shellモジュールを使用せざるを得ない場合は、必ずcreatesまたはremovesパラメータを設定して冪等性を担保すること」

このような指示を組み込むことで、AIが生成するPlaybookの品質はシニアエンジニアが記述するものに大きく近づきます。

Terraformモジュール設計へのAI活用とルール化

さらに、一からリソースを定義させるのではなく、「既存の社内モジュール」を利用させるように指示するアプローチも効果的です。

例えば、「以下のモジュール定義を参考にして、Webサーバー用のインスタンスを呼び出すコードを書いてください」と指定し、自社のモジュール定義書(READMEやvariables.tfの内容)をプロンプトに含めます。これにより、AIは独自の判断でリソース定義を行わず、社内で標準化された安全な構成要素(LEGOブロック)を組み立てる作業に集中するようになります。

4. 導入効果:工数削減以上の成果と残された課題

定型作業の自動化による工数50%削減の達成

適切にプロセスを導入した場合、新規環境構築にかかる初期コード作成時間が平均して50%以上削減される事例も報告されています。

過去のコードを探し出し、不要な部分を削り、変数を置換するといった数時間かかっていた作業が、プロンプトを入力して静的解析を通すだけで「8割完成」の状態まで到達可能になります。エンジニアは残りの2割(微調整や複雑なロジックの確認)に集中すればよいため、精神的な疲労も大幅に軽減されます。

ジュニアメンバーの学習ツールとしての副次効果

また、副次的なメリットとして、経験の浅いジュニアエンジニアがAIにコード解説を求めることで、自律的に学習を進められる環境が構築される点も挙げられます。

「このパラメータは何のためにあるのか」「なぜこの依存関係が必要なのか」とAIに質問すれば、即座に解説が得られます。AI生成コードは、単なる成果物ではなく「生きた教材」としても機能します。結果として、シニアエンジニアが教育に割く時間の削減にもつながります。

それでも残る「複雑な依存関係」への対応難易度

一方で、導入にあたって留意すべき課題も存在します。

特に、複数のモジュールが複雑に依存し合うような構成(例:VPC Peeringとルーティングテーブル、さらにTransit Gatewayが絡むようなネットワーク設計)においては、AIが一度で正しい依存関係(depends_onなど)を解決するのは困難な傾向にあります。

こうした複雑なロジックに関しては、人間が全体設計図を描き、AIにはその「部品」を作らせるという役割分担が不可欠です。「AIはあくまで手段であり、アーキテクトそのものになれるわけではない」という前提を理解しておくことが重要です。

5. これから導入するSREチームへの提言

「AIはシニアエンジニアのペアプロ相手」と心得る

これからAI活用を検討する開発現場においては、AIを「全自動構築ロボット」と見なすのではなく、「知識は豊富だが、時に誤りを含む優秀なアシスタント」あるいは「疲れを知らないペアプログラミングの相手」として捉えることが推奨されます。

AIにコードを生成させた後は、必ず人間がレビューを行います。そのレビュー負荷を下げるために、静的解析ツールという「機械の目」を間に挟む。この三重構造(AI作成 → ツール検査 → 人間承認)こそが、インフラ事故を防ぎつつROIを最大化するための実践的なアプローチです。

CI/CDパイプラインでの自動テスト必須化

本番環境への適用におけるリスクを低減する最大の武器は「テスト」です。AI生成コードに限らず、IaCコードはCI/CDパイプライン上で自動的にテストされる仕組みを構築すべきです。

terraform planの結果を自動でPR(プルリクエスト)にコメントする仕組みや、tfsecでHighリスクな設定が見つかった場合にマージをブロックする仕組みを整えることが重要です。これらのガードレールを設けることで、AIが不適切なコードを生成した場合でも、本番環境への影響を防ぐことが可能になります。

スモールスタートにおすすめの領域

いきなり基幹システムの構築をAIに任せるのではなく、まずは以下のような領域からスモールスタートを切ることが効果的です。

- 既存コードの解説: 「この複雑なTerraformコードが何をしているか要約して」

- テストコード生成: 「このAnsible RoleをテストするためのMolecule設定を作って」

- リファクタリング提案: 「このコードの可読性を上げるための改善案を出して」

これらは本番環境への直接的な変更を伴わないため、リスクを最小限に抑えられます。まずはこうした領域からAIの活用に慣れ、徐々に適用範囲を広げていくアプローチが推奨されます。

エンジニアの本来の役割は、単にコードを書くことではなく、ビジネス課題を解決し、信頼性の高いシステムを提供することにあります。AIという強力な手段を論理的に評価し、適切にプロジェクトへ組み込むことで、本質的な価値提供により多くのリソースを注力できるようになるでしょう。

コメント