イントロダクション

「営業部は『とにかく使いやすく、明日までに機能追加してくれ』と言う。一方で開発部は『セキュリティ要件とアーキテクチャの整合性が取れないから無理だ』と譲らない。板挟みの私は、今日も調整だけで一日が終わる……」

プロジェクトマネージャー(PM)や事業企画のリーダーとして、このような胃の痛くなるような経験をしたことはないでしょうか?

実務の現場における大規模なDXプロジェクトでも、全く同じ光景が広がっていることが少なくありません。会議室のホワイトボードには、相反する要望が殴り書きされ、空気は重く、エンジニアは腕を組み、営業担当者は時計を気にしている。PMはその間で、必死に言葉を選びながら妥協点を探っているのです。

AIエージェント開発や高速プロトタイピングの最前線から見えてくるのは、多くのDXプロジェクトが失敗する最大の要因は、実は技術的な難易度ではないという事実です。それは、部門間のコミュニケーション不全による「要件定義のミスマッチ」に他なりません。

The Standish Groupが発表したソフトウェアプロジェクトに関する調査レポート「CHAOS 2020: Beyond Infinity」によると、プロジェクトが当初の計画通りに成功する確率はわずか31%程度とされています。そして、失敗や課題が生じる原因の上位には常に「不完全な要件定義」や「ユーザー関与の欠如」「非現実的な期待」がランクインしています。初期段階での「ボタンの掛け違い」が、後工程での手戻りを生み、コスト超過や納期遅延、最悪の場合はプロジェクトの頓挫を招くのです。

従来、この調整役はPMの「人間力」や「政治力」、あるいは「気合」に依存していました。しかし、複雑化するビジネス要件と多様化するステークホルダーの間で、人間一人が全てのコンテキスト(文脈)を把握し、感情的な対立を裁くことには限界があります。

そこで提案したいのが、AIエージェントを「中立なファシリテーター」としてチームに招き入れるというアプローチです。「まず動くものを作る」というプロトタイプ思考において、AIは強力な推進力となります。

生成AI(Generative AI)は、単にコードを書いたり文章を作ったりするだけのツールではありません。異なる部門の「言語」を翻訳し、矛盾を客観的に指摘し、双方が納得できる「落としどころ」を提案する——そんな優秀な参謀になり得るのです。

本記事では、AIエージェントを活用して要件定義のミスマッチを自動的に修正し、スムーズな合意形成を実現するための具体的なプロセスをご紹介します。実際の開発現場で導入され、調整コストを劇的に削減している手法です。あなたのプロジェクトマネジメントを、ストレスフルな「伝書鳩」から、創造的な「意思決定者」へと進化させるヒントになれば幸いです。

なぜ「要件定義のミスマッチ」は人間だけでは防げないのか

まず、根本的な問題の構造にメスを入れましょう。なぜ、優秀なメンバーが集まっているはずなのに、話が噛み合わないのでしょうか。それは、各部門が見ている「正義」が異なり、人間特有の認知バイアスが働くからです。

部門ごとに異なる「言語」と「背景」の壁

営業部門は「顧客満足度」や「売上」を最優先します。彼らにとっての正義は「多機能で、直感的で、安いこと」です。一方、開発部門は「安定性」「保守性」「技術的負債の回避」を重視します。彼らの正義は「シンプルで、堅牢で、拡張可能なこと」です。

この二者が同じテーブルについても、使っている言葉の定義自体がズレていることが多々あります。

例えば「リアルタイム連携」という言葉一つとっても、営業は「入力した瞬間に画面に反映されること(UX視点)」を想像し、エンジニアは「ミリ秒単位のデータ同期処理と整合性担保(システム視点)」を想像します。この認識のズレは、PMがどんなに注意深く議事録をとっても、完全には防ぎきれません。

従来の会議・議事録スタイルが抱える構造的欠陥

多くの企業では、このズレを解消するために「定例会議」を開きます。しかし、ここにも人間ならではの罠があります。

- 確証バイアス: 自分たちの都合の良いように情報を解釈してしまう心理傾向。

- HiPPO現象(Highest Paid Person's Opinion): データや論理性よりも、「給料が一番高い人(役職者)」の意見が通ってしまう現象。

- 同期コミュニケーションの限界: 限られた会議時間内では、深い検討ができないまま「とりあえず持ち帰り」となり、決定が遅れます。

- 議事録の解釈ブレ: 「合意しました」と議事録に書いてあっても、その解釈が読み手によって異なる場合があります。

これらは、人間同士のコミュニケーションに必然的に伴う「ノイズ」です。

AIエージェントが「中立なファシリテーター」として機能する理由

ここでAIエージェントの出番です。AIには感情も、社内政治への忖度(そんたく)もありません。ただ入力されたデータに基づき、論理的な整合性をチェックするだけです。

AIを仲介役にするメリットは以下の3点です。

- 完全な中立性: どちらの部門にも肩入れせず、客観的な事実(ファクト)ベースで矛盾を指摘できます。

- 文脈の保持能力: RAG(Retrieval-Augmented Generation:検索拡張生成)技術を用いることで、膨大な過去のドキュメントやチャットログを外部知識として参照し、「先月の会議ではこう決まりましたよ」と即座に引用できます。

- 非同期での合意形成: 全員が同じ時間に集まらなくても、AIが個別にヒアリングを行い、情報を統合してくれます。

人間が調整すると「あのPMは開発寄りだ」などと角が立つ場面でも、AIが「要件Aと要件Bは論理的に矛盾しています」と指摘すれば、メンバーは冷静に受け止めやすくなるのです。これは心理的安全性を保つ上でも非常に有効です。

導入前の準備:AIエージェントに「共通言語」を学習させる

AIを魔法の杖のように振るう前に、重要な準備があります。それはAIに「このプロジェクトのルール」を教え込むことです。これを専門的には「コンテキストの注入(Context Injection)」と呼びます。

プロジェクト憲章と用語集の整備

何もない状態でAIに「調整して」と頼んでも、一般的な回答しか返ってきません。AIモデルは進化を続けており、例えばOpenAIのAPI環境では、利用率の低下に伴いGPT-4oなどのレガシーモデルが廃止され、より高度な文脈理解や推論能力を備えたGPT-5.2へと移行しています。こうした汎用知能の向上により、複雑な指示への追従性は飛躍的に高まりましたが、それでもプロジェクト固有の事情までは自動で把握できません。

まずは以下のドキュメントをテキスト化し、AI(ChatGPTのエンタープライズプラン、Azure OpenAI上の社内アプリ、あるいはNotion AIなど)に読み込ませる必要があります。

- プロジェクト憲章: ゴール、スコープ、予算規模、納期。これがAIにとっての「最上位の憲法」になります。

- 用語集: 社内用語や業界用語の定義。「顧客」とはエンドユーザーを指すのか、代理店を指すのか、といったレベルまで定義します。

- 組織図と役割: 誰がどの領域の決定権を持っているか。

これらを構造化データ(MarkdownやJSON形式が望ましい)としてAIにインプットすることで、AIはプロジェクト固有の文脈を正確に捉え、高度な推論を行うための強固な土台が整います。

各部門の役割と制約条件の定義(コンテキスト注入)

次に、各部門の「譲れない一線(制約条件)」を明確にしてインプットします。これはシステムプロンプトとして設定するのが効果的です。

インプットの例(システムプロンプトの一部):

あなたは本プロジェクト「Project Phoenix」の専任AI調整役です。

以下の制約条件を常に考慮して判断を行ってください。

## 営業部の優先事項(KPI)

- リリース目標: 202X年10月1日(絶対遵守)

- ターゲットデバイス: スマートフォン(iOS/Android)での操作性最優先

## 開発部の制約条件(Constraints)

- インフラ: AWS環境(予算上限: 月額$5,000)

- セキュリティ: 社内規定ランクA準拠(個人情報の暗号化必須)

- リソース: バックエンドエンジニア2名、フロントエンド2名(月間計80人日)

## 判断基準

これらの条件が衝突した場合、まずは「コスト」と「納期」のトレードオフを提示し、セキュリティ要件はいかなる場合も妥協しないこと。

このように、判断基準の重み付けを明示しておくことで、AIの提案精度が格段に上がります。

使用するAIツールとセキュリティ設定の確認

企業で導入する場合、機密情報の扱いは最重要です。「入力データが学習に利用される設定」がデフォルトとなっている無料のコンシューマー向けツールは避けるべきです。データガバナンスの観点からも、適切な環境選定が求められます。

現在は、以下のようなセキュリティとガバナンスが担保された環境の利用が推奨されます。

- エンタープライズ向けプランの活用: ChatGPTのTeam/Enterpriseプランなど、入力データがモデルの学習に利用されない契約形態を選びます。個人向けにも最新モデルへアクセスできる新プランが登場していますが、業務利用では組織管理が可能なプランが不可欠です。

- Azure OpenAIによる専用環境: 自社専用のインスタンスを構築します。最新の機能では、出力に含まれる個人情報を識別・ブロックするPII(個人識別情報)検出フィルターなども利用可能になっており、セキュリティガバナンスをより強固にできます。

- Microsoft Copilotや開発支援ツールの保護: Microsoft 365環境内であれば、商用データ保護が適用されるCopilotのビジネスプランを利用することで、社内ドキュメントに基づいた安全な回答生成が可能になります。また、GitHub CopilotやReplitなどの開発支援AIを併用する場合、利用可能なモデルの統廃合や機能変更が頻繁に行われるため、最新の仕様やセキュリティ要件については必ず公式ドキュメントで確認する必要があります。

「ここでの会話は外部に漏れない」という確実な安心感があって初めて、メンバーは本音の要望や懸念を共有してくれます。古いモデルに依存した社内システムがある場合は、速やかに最新環境への移行計画を立て、組織のポリシーに合致した安全なツールを選定してください。

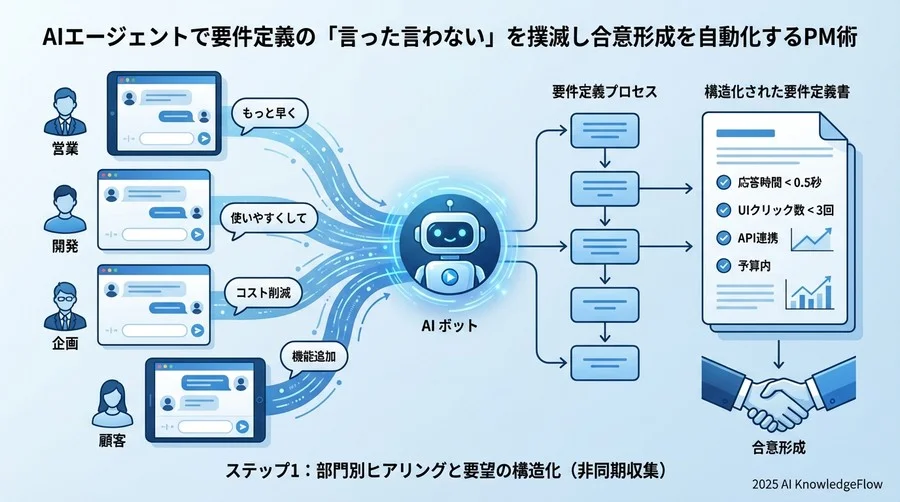

ステップ1:部門別ヒアリングと要望の構造化(非同期収集)

準備が整ったら、いよいよ実践です。まずはAIを使って、各部門からの要望を集めます。ここでのポイントは「全員集めて会議をしない」ことです。

AIインタビューボットによる個別要望の吸い上げ

PMが一人ひとりにヒアリングして回るのは大変ですが、AIなら同時並行で何人でも相手にできます。SlackやTeamsなどのチャットツールにAIボットを連携させ、担当者に個別にインタビューを行わせます。

人間相手だと「こんなこと言ったら怒られるかな」「わがままかな」と躊躇するような些細な懸念も、相手がAIなら「とりあえず書いておこう」という心理になりやすく、潜在的なリスクを洗い出すのに有効です。

曖昧な表現を具体的要件に変換するプロンプト設計

人間は往々にして曖昧な言葉を使います。「サクサク動くようにして」「いい感じのデザインで」。これをそのまま開発に伝えると事故の元です。

AIエージェントには、曖昧な言葉を検知したら深掘り質問をするよう指示を与えておきます。これを「明確化プロンプト(Clarification Prompt)」と呼びます。

実際の対話ログ例:

営業担当: 「検索機能はサクサク動くようにしてほしい。」

AIエージェント: 「『サクサク』という表現について具体化させてください。ユーザーが検索ボタンを押してから結果が表示されるまでの許容時間は何秒以内でしょうか?(例: 1秒以内、3秒以内)」

営業担当: 「うーん、ECサイト並みだから1秒以内かな。」

AIエージェント: 「承知しました。『検索レスポンス:1秒以内』を非機能要件として記録します。なお、これを実現するには検索エンジンの追加導入が必要になる可能性があり、開発コストに影響する場合がありますが、よろしいですか?」

営業担当: 「あ、コストかかるなら2秒でもいいかも。」

このように、会話の中で自然に定性的な要望を定量的な要件(非機能要件)へと変換していきます。PMがこれをやると「詰問されている」と感じられがちですが、AIだとスムーズに進むことが多いのです。

要望の「必須・推奨・任意」への自動分類

ヒアリングした内容は、AIによって自動的に整理されます。ここではMoSCoW分析(Must:必須、Should:推奨、Could:可能なら、Won't:今回は見送り)などのフレームワークを用いて、重要度をタグ付けさせると良いでしょう。

AIに「この要望がないと業務が停止しますか?」といった質問を投げかけさせ、担当者自身に優先度を判断させるプロセスを組み込むのも効果的です。

ステップ2:矛盾点(コンフリクト)の自動検知と可視化

各部門の要望が出揃ったら、それらを突き合わせて矛盾を探します。人間がマトリクス表を作ってチェックすると数日かかるこの作業も、AIなら一瞬です。

部門間での要件衝突パターンの特定

AIに全部門のヒアリング結果を読み込ませ、以下のようなプロンプトで分析を依頼します。

プロンプト例:

以下の「営業部の要望リストA」と「開発部の制約リストB」を比較し、論理的に矛盾する箇所、またはリソース的に実現困難な組み合わせを抽出してください。それぞれの矛盾について、何が対立しているのか簡潔に説明してください。

AIは以下のようなレポートを出力してくれます。

- 矛盾検知 #1(重大度: 高):

- 対立内容: 営業部は「全データのリアルタイム同期」を求めていますが、開発部は「バッチ処理による夜間更新」を前提としたアーキテクチャを提案しています。

- 原因: 営業部のUX要件と、開発部のインフラコスト制約の衝突。

- 矛盾検知 #2(重大度: 中):

- 対立内容: デザイン要望にある「高解像度動画の自動再生」は、インフラ要件の「通信量削減目標」および「モバイルでの表示速度要件」と相反します。

「コスト」「納期」「品質」のトレードオフ分析

単に「矛盾しています」と言うだけでなく、それがプロジェクトのQCD(Quality:品質・Cost:コスト・Delivery:納期)にどう影響するかをシミュレーションさせます。

「リアルタイム同期を実現するには、追加のクラウドコスト(DynamoDB等の利用)が月額約$2,000発生し、開発工数が2週間(10人日)延びる可能性があります」といった具合です。ここまで具体的な数字(概算でも可)が出ると、意思決定が感情論から投資対効果の議論へとシフトします。

AIによる「論点整理レポート」の生成

抽出された矛盾点は、人間が感情的にならずに議論できる形に整形します。「営業がわがままだ」ではなく、「要件Aと制約Bの間にトレードオフが存在する」という客観的な課題として提示するのです。

このAI生成レポートを事前に共有した上で会議を行えば、会議の目的は「状況確認」ではなく「解決策の選択」に絞られ、時間は大幅に短縮されます。実際、適切に導入されたプロジェクトでは、要件定義フェーズの会議時間が40%前後削減される事例も報告されています。

ステップ3:解消案の提示と合意形成ドキュメントの生成

問題が可視化されたら、最後は解決策の策定と合意です。ここでもAIの「発想力」と「文書化能力」を借ります。

AIによる「松・竹・梅」3つの解決案の提示

対立する要件に対して、AIに複数の折衷案を出させます。実務においては、「松・竹・梅」の3パターンを出させるアプローチが効果的です。

- 松(理想案): コストと時間をかけて、双方の要望を完全に満たす案。

- 竹(現実案): 重要な要件のみを満たし、一部を妥協するバランス案。

- 梅(ミニマム案): コストと納期を最優先し、機能を削ぎ落とす案。

AIの出力イメージ:

対立点: 検索速度(1秒以内) vs 開発コスト(予算内)

- 案1(松 - ハイパフォーマンス): Elasticsearchを導入し、1秒以内の検索を実現。追加ライセンス費とインフラ費で+200万円。工数は+3週間。

- 案2(竹 - バランス): 既存DB(PostgreSQL)のインデックス最適化とキャッシュ戦略で対応。速度は平均2-3秒だが追加コストなし。工数は+3日。

- 案3(梅 - スコープ縮小): フリーワード検索機能を次フェーズ(Phase 2)に見送り、カテゴリ絞り込み機能のみ実装。コスト・工数ともに最小。

人間がゼロから案を考えると、「開発寄りだ」などのバイアスがかかりますが、AIが機械的に選択肢を提示することで、「今回は予算がないから『竹』でいこう」という冷静な判断が可能になります。

関係者レビューとフィードバックの統合プロセス

選択された案に対して、関係者から最終確認をとります。ここでのフィードバックもAIが集約し、「法務部から利用規約に関する指摘あり、案2の修正が必要」といった具合にアップデートをかけます。

最終合意文書(要件定義書)への自動落とし込み

合意に至った内容は、即座にAIによって正式なドキュメント(要件定義書や仕様書)に変換されます。「言った言わない」を防ぐため、決定に至った経緯(なぜ案2を選んだのか、誰が承認したのか)も備考欄や決定ログとして残させることが重要です。

このプロセスを経ることで、作成されたドキュメントは単なる書類ではなく、全員が納得した「契約書」としての重みを持つようになります。

運用上の注意点:AIは「責任者」ではなく「参謀」である

ここまでAIの活用メリットを強調してきましたが、最後に重要な釘を刺しておきます。AIはあくまでツールであり、プロジェクトの責任者は人間です。倫理的なAI開発の観点からも、この原則は揺るぎません。

AIの提案を鵜呑みにしない「Human-in-the-Loop」の徹底

AIは非常に論理的ですが、時に「もっともらしい嘘(ハルシネーション)」をついたり、倫理的に問題のある提案をしたりすることがあります。また、社内の微妙な人間関係や、データ化されていない暗黙の事情までは考慮できません。

必ず「Human-in-the-Loop(人間が介在するループ)」を維持してください。AIが出した矛盾レポートや解決案は、PMが必ず目を通し、肌感覚と照らし合わせて違和感がないか検品するプロセスが不可欠です。

PMのチェックリスト例:

- AIが引用している「過去の合意事項」は事実か?(元データを確認)

- 提示されたコスト概算は、現在の市場価格と乖離していないか?

- その提案は、企業の倫理規定やコンプライアンスに違反していないか?

最終的な意思決定権限の所在

「AIが決めたから」という言い訳は、プロフェッショナルとして通用しません。AIは選択肢を提示しますが、どの道を進むかを決断し、その結果に責任を持つのは人間の役割です。

チームメンバーに対しても、「AIに管理されている」と感じさせない配慮が必要です。「AIは面倒な調整作業をやってくれる優秀な秘書で、私たちがクリエイティブな仕事に集中するために導入するんだ」というメッセージを伝え、心理的な抵抗を減らしましょう。

まとめ

要件定義における部門間のミスマッチは、AIエージェントを活用することで、構造的に防ぐことが可能です。

- 準備: プロジェクトの「憲法(プロジェクト憲章)」と「制約条件」をAIに学習させる。

- ヒアリング: AIボットが非同期で個別に要望を深掘りし、数値化・構造化する。

- 矛盾検知: 感情を排して、論理的な対立とトレードオフ(QCDへの影響)を可視化する。

- 合意形成: 松竹梅の選択肢から人間が意思決定し、ドキュメント化を自動化する。

このプロセスを導入することで、PMは「伝言ゲーム」のストレスから解放され、本来注力すべき「プロジェクトの価値最大化」や「チームビルディング」「ステークホルダーマネジメント」に時間を使えるようになります。

もちろん、いきなり全てのプロセスを自動化する必要はありません。まずは「議事録からの矛盾検知」や「用語集の整備」といった小さな一歩から始めてみてはいかがでしょうか。

もし、「自社の組織構造に合わせたAIエージェントの設計方法が知りたい」「具体的なプロンプトのテンプレートが欲しい」「どのAIツールを選定すべきか検討したい」といった課題があれば、専門家の知見を活用しながら、プロジェクト特有の課題に合わせた最適なAI導入のロードマップを描くことをおすすめします。

AIを味方につけて、スマートで健全なプロジェクト運営を実現してください。

コメント